更新时间:2025-03-11 10:40:33点击:

字节跳动旗下的豆包大模型团队开源优化技术,令其训练成本节约四成。上述团队宣布开源混合专家模型(MoE)架构的关键优化技术。此技术通过一系列创新方法,将大模型的训练效率提升约1.7倍,同时也将训练成本降低40%。

这一技术已在字节跳动的万卡集群训练中得到实际应用。内部数据显示,自采用该技术以来,已累计节省了数百万GPU(图形处理器)小时的训练算力。

豆包大模型团队决定开源此技术,是希望通过分享这一技术,推动整个人工智能(AI)社区在模型训练效率方面的共同进步。开源不仅有助于加速行业技术发展,还能为更多研究者和开发者提供宝贵的资源,进一步推动AI技术的创新与应用。

字节跳动推出的豆包大模型,成为中国市场上最受欢迎的AI聊天机器人。

专题:豆包

兵种军旗自2025年8月1日启用

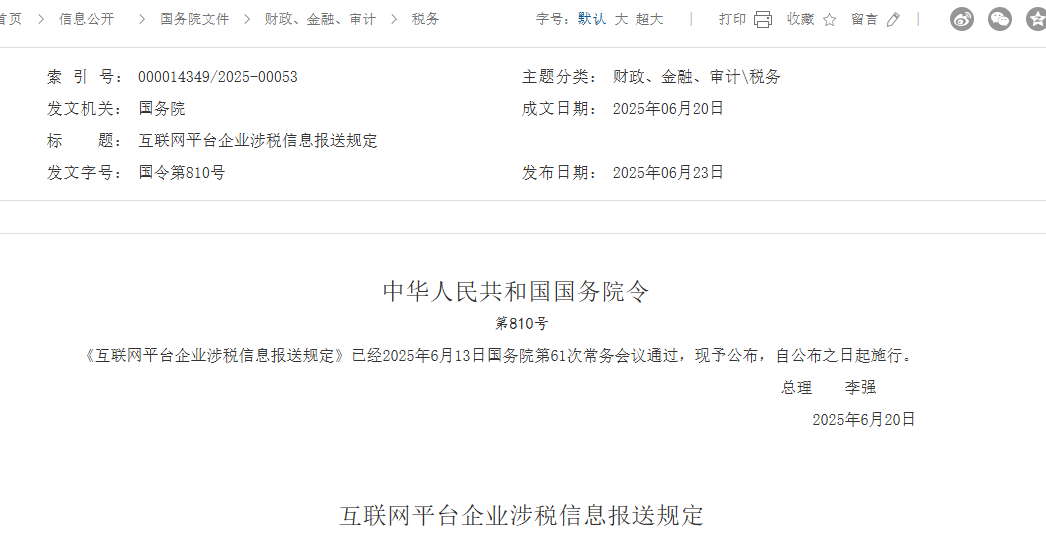

互联网平台企业涉税信息报送规定(国令第810号)

中国知名的律师

专业技术人员职业资格考试都有哪些?

2025胡润中国茶业百强县

各地知名的专业律师查询

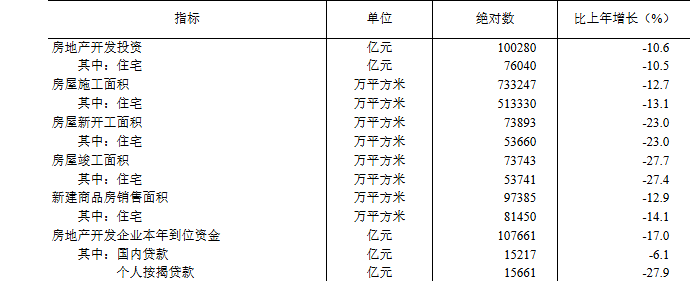

2024年房地产开发和销售数据

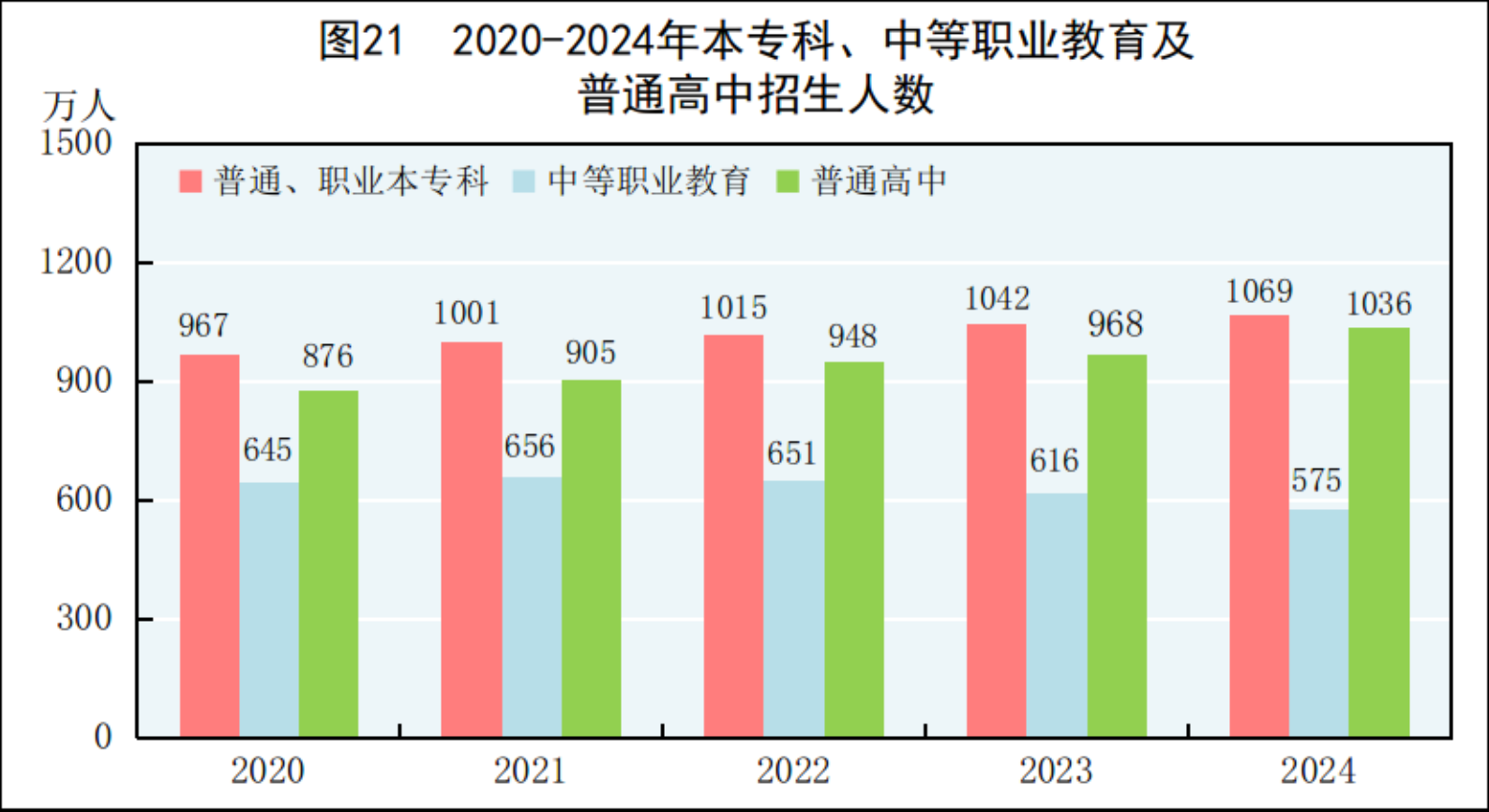

2024年全国各类学校招生、在校生、毕业生数据

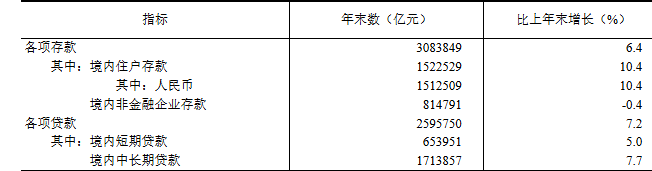

2024年全国贷款数据

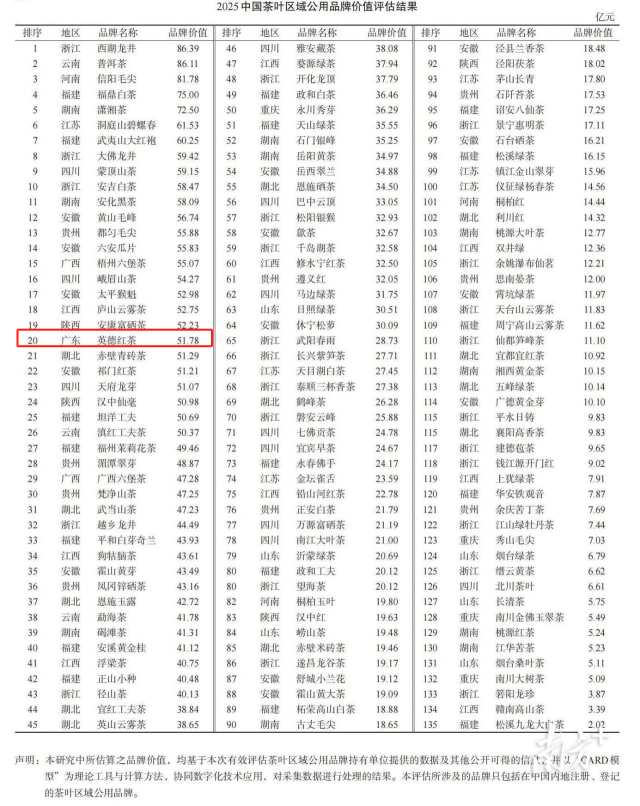

2025中国茶叶区域公用品牌价值评估报告

如何办理茶叶食品生产许可证SC?

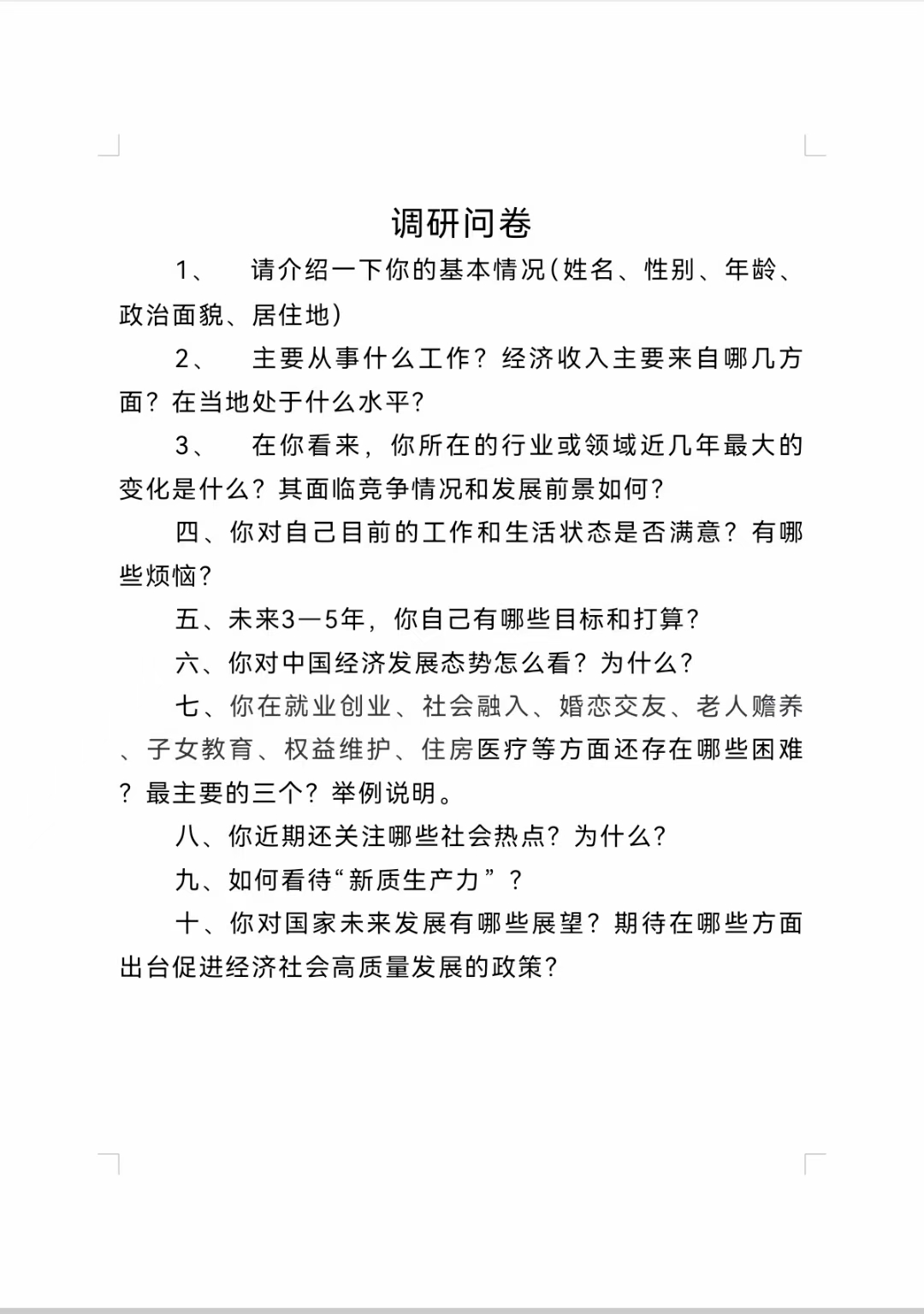

调查问卷信息

网络新闻发布须知

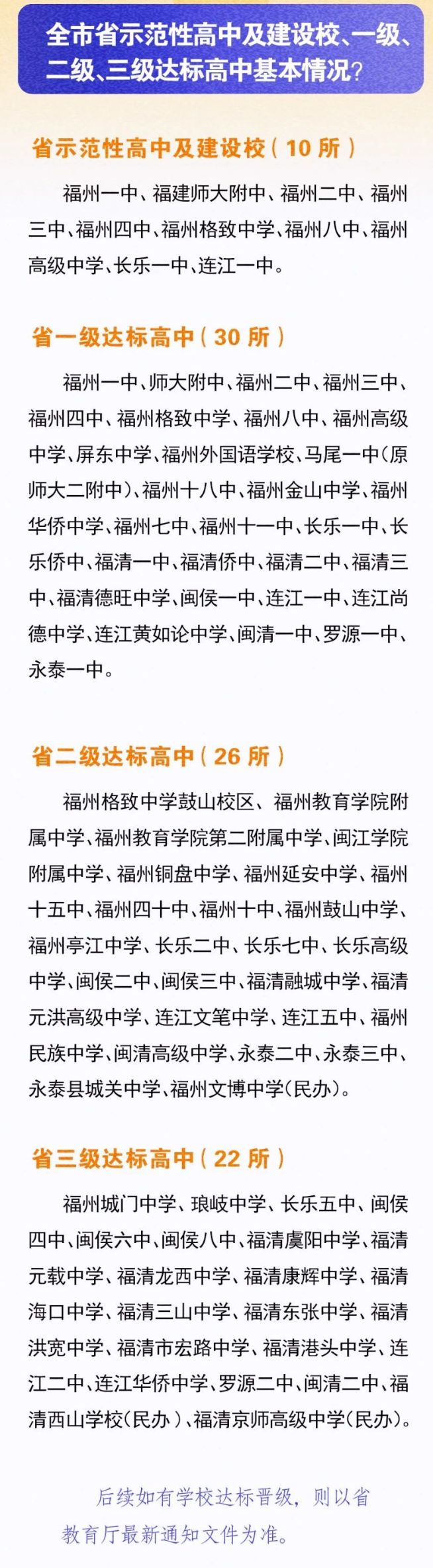

福州市高中排名

虚假交易”的违规类型:刷单刷评和炒信作弊

证券期货业App安全认证获证产品目录

62款完成个人信息收集使用合规整改App清单

华为应用市场应用分类示例

广告不得有下列情形——福建发布2024年第二批虚假违法广告典型案例

2024年福州普高(含综合高中班)录取分数线排名